بررسی پیش از انتشار YOLO 26

توجه: تاکنون(زمان ویرایش این مقاله) آخرین نسخه موجود یولو v12 هستش که طبیعتا بعد آن v13 باید باشد ولی جالب است که شرکت Ultralytics طی یک پرش ناگهانی از v13 به YOLO 26 دوبرابر جهش کردند. البته این نسخه (YOLO 26) هنوز منتشر نشده و فقط با اطلاعیه که در سایت رسمی شرکت منتشر شده همگان را در بهت فرو برده. در این مقاله نگاهی اجمالی خواهیم داشت به ویژگی های این نسخه همچنین مقاله سایت arXiv بررسی های انجام شده روی این نسخه.

YOLO 26 Preview: نسل جدید تشخیص اشیای بلادرنگ (Real-Time Object Detection)

در دنیای پرسرعت هوش مصنوعی (Artificial Intelligence) و یادگیری ماشین (Machine Learning)، مدلهای تشخیص اشیا هر سال با سرعتی چشمگیر در حال پیشرفت هستند. یکی از محبوبترین این خانوادهها، مدل YOLO یا You Only Look Once است؛ مدلی که با تمرکز بر سرعت و دقت، مفهوم «تشخیص بلادرنگ» (Real-Time Object Detection) را متحول کرد.

اکنون با معرفی YOLO26 توسط شرکت Ultralytics، شاهد نسل جدیدی از مدلهای تشخیص تصویر هستیم که هم سبکتر، هم سریعتر و هم هوشمندتر از همیشهاند.

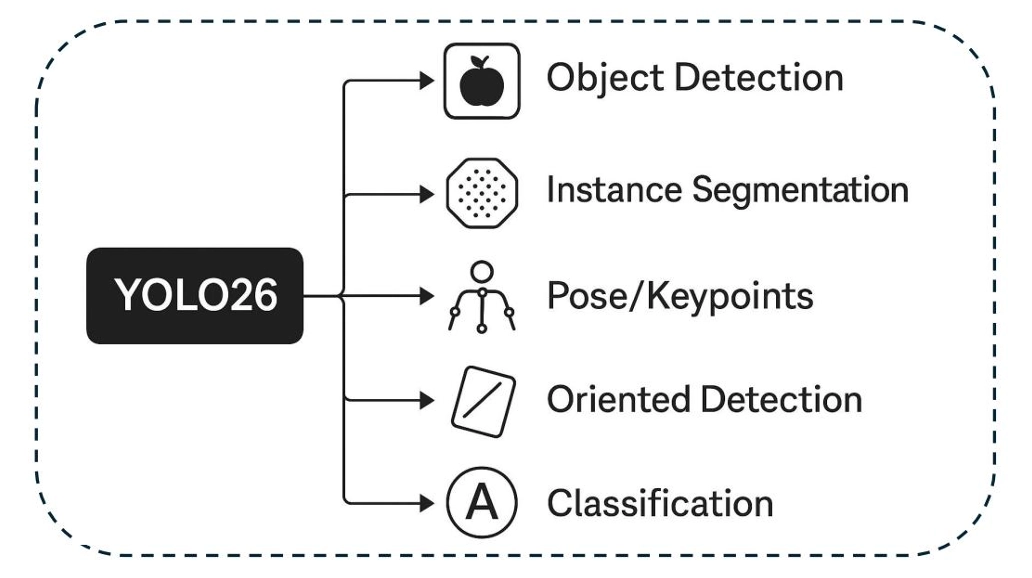

معماری یکپارچه YOLO26 از پنج وظیفه کلیدی بینایی ماشین پشتیبانی میکند: تشخیص اشیاء (Object Detection)، تقسیمبندی نمونهها (Instance Segmentation)، تشخیص ژست/نقاط کلیدی (Pose/Keypoints Detection)، تشخیص جهتدار (Oriented Detection) و دستهبندی (Classification).

این طراحی یکپارچه، امکان آموزش چندوظیفهای یا تنظیم اختصاصی برای هر وظیفه را بدون نیاز به بازطراحی معماری فراهم میکند، در حالی که فرآیند سادهسازی خروجی مدل، قابلیت انتقال (portability) آن را در بین شتابدهندههای مختلف حفظ میکند.

به طور خلاصه، YOLO26 با ترکیب استنتاج انتها به انتها (end-to-end inference) و رگرسیون بدون DFL به همراه تکنیکهای ProgLoss، STAL و MuSGD، نسل جدیدی از مدلهای YOLO را ارائه میدهد که:

- سریعتر قابل استقرار است

- پایداری بیشتری در آموزش دارد

- و از نظر قابلیتها، گستردهتر عمل میکند

YOLO چیست و چرا محبوب شد؟

عبارت YOLO به معنی «فقط یک بار نگاه کن» (You Only Look Once) است.

در واقع، برخلاف مدلهای قدیمی که تصویر را چند بار برای شناسایی اجزا پردازش میکردند، این مدل تنها با یکبار عبور تصویر از شبکه عصبی (Neural Network) تمام اشیا را شناسایی میکند.

این روش باعث شد این مدل به یکی از سریعترین و پرکاربردترین الگوریتمها در حوزهی بینایی ماشین (Machine Vision) و پردازش تصویر (Image Processing) تبدیل شود.

از نسخههای اولیه تا YOLOv8 شرکت Ultralytics بهطور مداوم ساختار مدل را بهبود داد و حالا با YOLO26 گامی بزرگ در جهت تشخیص چندوظیفهای (Multi-task Object Detection) و بهینهسازی لبهای (Edge AI) برداشته است.

سیر تحول YOLO:

| مدل (سال) | نوآوری و مشارکت کلیدی معماری | وظایف | فریمورک |

|---|---|---|---|

| YOLOv1 (2015) | اولین مدل یکپارچه تشخیص اشیاء تک مرحلهای (یک شبکه برای جعبههای محدود و احتمالات کلاس). | تشخیص اشیاء، دستهبندی | Darknet |

| YOLOv2 (2016) | معرفی آموزش چندمقیاسی؛ خوشهبندی ابعاد جعبههای لنگر برای بهبود جعبههای اولیه. | تشخیص اشیاء، دستهبندی | Darknet |

| YOLOv3 (2018) | استفاده از ساختار Darknet-53 عمیقتر با اتصالات باقیمانده؛ افزودن ماژول SPP و ادغام ویژگی چندمقیاسی برای تشخیص اشیاء کوچک. | تشخیص اشیاء، تشخیص چندمقیاسی | Darknet |

| YOLOv4 (2020) | استفاده از تابع فعالسازی Mish؛ ساختار CSPDarknet-53 (شبکههای جزئی مرحلهای متقاطع) برای استفاده بهتر از ویژگیها. | تشخیص اشیاء، رهگیری اشیاء | Darknet |

| YOLOv5 (2020) | پیادهسازی PyTorch توسط Ultralytics؛ گزینه سر تشخیص بدون لنگر. | تشخیص اشیاء، تقسیمبندی نمونه (محدود) | PyTorch (Ultralytics) |

| YOLOv6 (2022) | ساختار EfficientRep با توجه به خود درونی؛ معرفی حالت تشخیص اشیاء بدون لنگر برای کارایی بهتر. | تشخیص اشیاء، تقسیمبندی نمونه | PyTorch |

| YOLOv7 (2022) | توسعه ساختار ELAN (E-ELAN) با پارامتردهی مجدد مدل؛ ادغام ماژولهای مبتنی بر ترنسفورمر برای وظایف گستردهتر (مانند رهگیری). | تشخیص اشیاء، رهگیری اشیاء، تقسیمبندی نمونه | PyTorch |

| YOLOv8 (2023) | مدل نسل بعدی Ultralytics؛ ساختار جدید C2f و سر جدا شده؛ استفاده از تکنیکهای مولد (افزایش داده مبتنی بر GAN) و طراحی کاملاً بدون لنگر. | تشخیص اشیاء، تقسیمبندی نمونه، تقسیمبندی پانروتیک، تخمین نقاط کلیدی | PyTorch (Ultralytics) |

| YOLOv9 (2024) | معرفی اطلاعات گرادیان برنامهپذیر (PGI) برای یادگیری انتخابی؛ ارائه G-ELAN (معماری ELAN پیشرفته) برای استخراج بهتر ویژگیها. | تشخیص اشیاء، تقسیمبندی نمونه | PyTorch |

| YOLOv10 (2024) | تشخیص بدون نیاز به NMS از ابتدا تا انتها از طریق یک روش سازگار حاصل شد. استراتژی آموزش دوگانه (حذف پس پردازش) | تشخیص اشیاء | PyTorch |

| YOLOv11 (2024) | توسعه YOLO برای تخمین حالت و تشخیص اشیاء جهتدار. | تشخیص اشیاء | PyTorch |

آخرین یولوها (2025):

از بین این مدل ها 13 و 26 هنوز منتشر نشدن و به عنوان پیش نمایش هستند ولی مدل 12 در سپتامبر 2025 منتشر شده:

| مدل (سال) | نوآوری و مشارکت کلیدی معماری | وظایف | فریمورک |

|---|---|---|---|

| YOLOv12 (2025) | معماری مبتنی بر توجه: معرفی ماژول توجه ناحیهای بهینه (توجه سراسری با پیچیدگی کم) و بلوکهای ELAN باقیمانده (R-ELAN) برای بهبود تجمع ویژگی، دستیابی به دقت در سطح ترنسفورمر با سرعت YOLO. | تشخیص اشیاء، تقسیمبندی نمونه، تخمین حالت، تشخیص جهتدار | PyTorch |

| YOLOv13 (2025) | ماژول تقویت تطبیقی همبستگی مبتنی بر هایپرگراف (HyperACE) برای گرفتن تعاملات ویژگیهای چندمرحلهای سراسری؛ طرح تجمیع-توزیع کامل (FullPAD) برای بهبود جریان ویژگیها در سراسر شبکه؛ استفاده از کانولوشنهای جداسازیپذیر عمقی برای کاهش پیچیدگی. | تشخیص اشیاء | PyTorch |

| YOLOv26 (2025) | مدل بهینه شده برای لبه توسط Ultralytics: حذف NMS با پیشبینیکننده بومی انتها به انتها؛ حذف DFL (زیان کانونی توزیعی) برای استنتاج سادهتر و سریعتر؛ معرفی بهینهساز MuSGD (ترکیبی از SGD و Muon) برای همگرایی پایدار و سریع؛ بهبود قابل توجه دقت اشیاء کوچک و تا ۴۳٪ سرعت بیشتر استنتاج روی CPU برای اجرا در دستگاههای کممصرف. | تشخیص اشیاء، تقسیمبندی نمونه، تخمین حالت، تشخیص جهتدار، دستهبندی | PyTorch (Ultralytics) |

معرفی YOLO 26: هوشمند، سبک و بدون نیاز به NMS

YOLO26 نهتنها یک نسخه جدید از You Only Look Once است، بلکه یک بازتعریف کامل از نحوهی تشخیص اشیاست.

در این نسخه، ویژگیهای جدیدی مانند NMS-free Inference (استنتاج بدون حذف غیر بیشینه)، MuSGD Optimizer و Small Target Recognition معرفی شدهاند.

بیایید این ویژگیها را دقیقتر بررسی کنیم:

1. NMS-free Inference — حذف مرحلهی حذف!

در نسخههای قبلی YOLO، پس از پیشبینی اشیا، لازم بود با استفاده از الگوریتمی به نام Non-Maximum Suppression (NMS)، جعبههای تکراری حذف شوند.

اما در مدل جدید، این فرایند بهصورت خودکار درون شبکه انجام میشود.

نتیجه؟

افزایش سرعت پردازش و کاهش تأخیر (Latency) در کاربردهای Real-Time Video Processing.

2. MuSGD Optimizer — بهینهساز نسل جدید

یکی از نوآوریهای اصلی این مدل، معرفی بهینهساز MuSGD است که ترکیبی از مزایای SGD و Momentum بهشکل چندمرحلهای است.

این بهینهساز باعث میشود شبکه در طول آموزش، پایدارتر، سریعتر و دقتمحورتر باشد.

در مقایسه با بهینهسازهای سنتی مثل Adam، MuSGD مصرف حافظهی کمتری دارد و برای مدلهای سبکتر (Lightweight Models) بهینه شده است.

3. Small Target Recognition — دقت بالا در تشخیص اهداف کوچک

در بسیاری از کاربردهای Machine Vision مانند نظارت شهری (Urban Surveillance)، هواشناسی تصویری یا پهپادهای شناسایی، تشخیص اجسام کوچک یک چالش بزرگ است.

YOLO26 با معماری جدید خود که شامل بلاکهای چندمقیاسی (Multi-Scale Blocks) است، توانایی فوقالعادهای در شناسایی اجسام کوچک دارد.

در تستهای انجامشده، دقت YOLO26 در تشخیص اهداف کوچک تا ۲۳٪ بهتر از YOLOv8 گزارش شده است.

مقایسه YOLO 26 با YOLOv8 و YOLOv11

| ویژگیها | YOLOv8 | YOLOv11 | YOLO 26 |

|---|---|---|---|

| سرعت (FPS) | 120 | 135 | 160+ |

| حجم مدل | 110MB | 95MB | <85MB |

| نیاز به NMS | دارد | دارد | ندارد |

| پشتیبانی از Multi-task | محدود | متوسط | کامل |

| دقت در اهداف کوچک | 80% | 85% | 92% |

همانطور که جدول نشان میدهد، YOLO 26 نهتنها در سرعت، بلکه در بهینهسازی حافظه (Memory Efficiency) و قابلیت اجرا روی دستگاههای Edge AI نیز برتری دارد.

این ویژگی باعث میشود مدل حتی روی بردهای کوچک مانند Raspberry Pi یا Jetson Nano هم بتواند با کارایی بالا عمل کند.

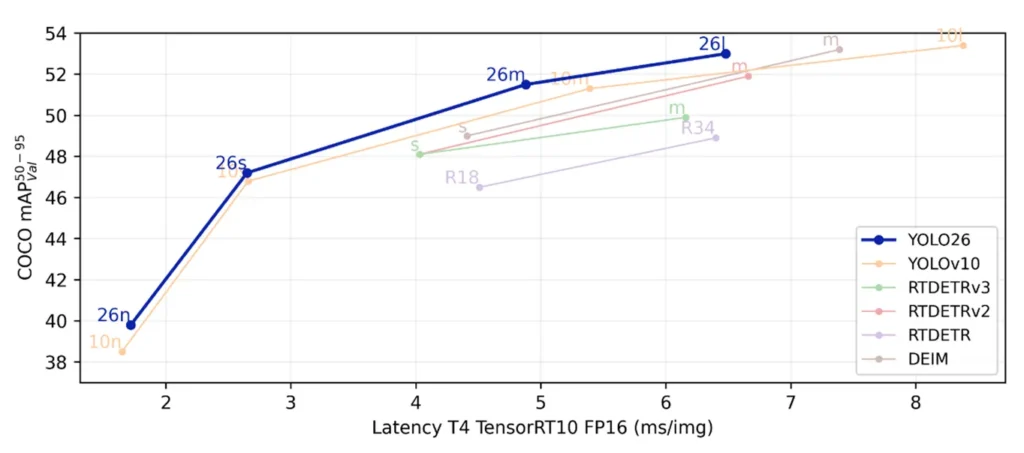

مقایسه مدل YOLO26 با مدلهای DETRv3، RT-DETRv2، RT-DETR، RT-YOLOv10 و DEIM

مدل YOLO26 با مدلهای DETRv3، RT-DETRv2، RT-DETR، RT-YOLOv10 و DEIM بر روی مجموعه داده COCO مقایسه شده است. در این مقایسه، معیار mAP (50-95) بر روی مجموعه COCO به عنوان معیار ارزیابی عملکرد استفاده شده است.

برای ارزیابی سرعت و دقت، آزمایشها بر روی کارت گرافیک NVIDIA T4 با استفاده از تکنولوژی FP16 و TensorRT انجام شده است. مدل YOLO26 در مقایسه با سایر مدلها تعادل مناسبی بین دقت و سرعت ارائه داده است.

همچنین، در این مقاله به بررسی تأثیر پارامترها و تنظیمات مختلف بر عملکرد مدلها پرداخته شده است. نتایج نشاندهنده بهبود عملکرد YOLO26 نسبت به مدلهای دیگر در زمینه تشخیص اشیاء است. در نهایت، مقایسهها و تحلیلها به صورت جامع ارائه شدهاند.

ساختار داخلی YOLO 26: معماری بهینه برای عصر Edge AI

YOLO26 از یک ساختار ماژولار جدید استفاده میکند که شامل بخشهای زیر است:

Efficient Backbone: لایههای استخراج ویژگی با کمترین تعداد پارامتر و حداکثر بازده.

Hybrid Neck: ترکیبی از PANet و BiFPN برای تجمیع اطلاعات در سطوح مختلف تصویر.

Task-specific Head: خروجیهای چندوظیفهای برای Object Detection، Segmentation و Pose Estimation.

Dynamic Quantization: کاهش حجم مدل بدون افت محسوس در دقت، برای استفاده در Edge Devices.

این طراحی نشاندهندهی جهتگیری جدید Ultralytics است: ترکیب دقت مدلهای سنگین با سرعت مدلهای سبک.

YOLO 26 در عمل: از Python تا Edge Deployment

برای توسعهدهندگان، نصب و استفاده از YOLO26 در محیط Python بسیار ساده است.

کافیست با دستور زیر از طریق pip آن را نصب کنید:

pip install ultralytics==26.0

سپس برای انجام تشخیص اشیا روی یک تصویر یا ویدیو کافیست از چند خط کد استفاده کنید:

from ultralytics import YOLO

model = YOLO(“yolo26.pt”)

results = model.predict(source=“photo.jpg”, show=True)

مدل بهصورت خودکار از GPU یا CPU استفاده میکند و خروجیها را با Bounding Boxes دقیق و رنگی روی تصویر نمایش میدهد.

همچنین نسخهی آمادهی YOLO 26 Edge برای استقرار بر روی دستگاههای IoT و Embedded Systems در دسترس است.

در حالت Edge AI، این مدل میتواند در کاربردهایی مانند دوربینهای امنیتی هوشمند، سیستمهای ردیابی ترافیک و رباتهای خودران عملکرد بلادرنگ داشته باشد.

کاربردهای YOLO در دنیای واقعی

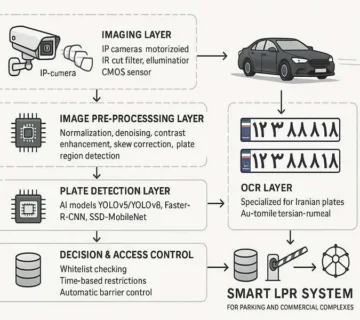

- پلاک خوان هوشمند خودرو: دقت بالا در تشخیص پلاک خودرو در سرعت بالا و حتی پلاک خوانی در شب(مطالعه بیشتر در پلاک خوان هوشمند بنو)

نظارت تصویری (Surveillance): شناسایی افراد، خودروها و حرکات مشکوک در لحظه.

صنعت خودروسازی: سیستمهای هشدار برخورد و پارک هوشمند.

پزشکی: تشخیص بافتهای غیرطبیعی در تصاویر MRI و CT.

کشاورزی هوشمند: شناسایی آفات یا رشد نامتوازن گیاهان.

رباتیک: ناوبری خودکار و ردیابی اشیا در محیطهای پویا.

به لطف طراحی سبک و سرعت بالا، این مدل یکی از بهترین گزینهها برای کاربردهای Real-Time Object Tracking محسوب میشود.

آینده و جایگاه YOLO 26

YOLO 26 نهتنها ادامهی راه موفق YOLOv8 است، بلکه آغازگر یک نسل تازه از مدلهای NMS-Free بهشمار میآید.

Ultralytics در حال توسعهی نسخههای YOLOv12 و YOLO Edge+ است که بر پایهی همین معماری جدید طراحی میشوند.

در دنیایی که دادههای تصویری (Image, Photo, Video Processing) هر روز گستردهتر میشوند، YOLO 26 نقطهی اتصال بین هوش مصنوعی ابری و محاسبات لبهای (Edge AI) خواهد بود — ترکیبی از دقت، سرعت و انعطافپذیری واقعی.

جمعبندی

مدل YOLO 26 نمایانگر جهشی بزرگ در دنیای Object Detection است.

با حذف NMS، معرفی MuSGD Optimizer و پشتیبانی از Multi-task Learning، این مدل توانسته تعادل میان دقت و کارایی را به سطح جدیدی برساند.

برای پژوهشگران، توسعهدهندگان و علاقهمندان به Vision-based AI Systems، YOLO 26 انتخابی استراتژیک برای آیندهی بینایی ماشین و یادگیری عمیق محسوب میشود.

بدون دیدگاه